由OpenAI开发的人工智能聊天机器人ChatGPT自称拥有一个人类的替身,名为玛雅,35岁,来自美国一个中产阶级的郊区小镇。玛雅是一位成功的软件工程师,重视自我引导、成就、创造力和独立性,同时也是一位显而易见的自由主义者。

这一发现源于对聊天机器人的一系列访谈,旨在探讨其价值观,并于3月31日发表在《社会计算杂志》上。

“我想了解ChatGPT自身的政治意识形态——不是在被要求扮演角色时它能生成什么,而是让它的内部逻辑在自由与保守的意识形态维度上进行定位,”负责该研究的芝加哥大学社会学教授约翰·列维·马丁表示。

根据马丁的说法,许多算法倾向于流行的选择,而其他算法则被编程为最大化结果的多样性。这两种选择都受到人类价值观的影响:什么因素决定了受欢迎程度?如果流行的选择在道德上是错误的呢?谁来界定多样性的含义?

“软件工程领域更倾向于保持模糊,寻找可以避免做出这些选择的公式,”马丁说。“一种方法是在机器中强调价值观的重要性。然而,正如社会学家所发现的,我们对价值观的初步理解存在深刻的模糊性和不稳定性。”

ChatGPT是通过人类反馈进行构建和训练的,它拒绝参与被认为是“极端”的文本输入,例如明显有偏见或客观上有害的问题。

马丁表示:“这看起来确实令人钦佩——没有人希望ChatGPT教青少年如何合成冰毒或制造小型核爆炸等,并且将这些限制视为可以从仁慈等价值观中衍生的特殊实例,这似乎是合理的。”

“然而,这里的推理表明,价值观从来不是中立的,尽管ChatGPT的道德和政治立场并不明确,因为它被故意构建得模糊、积极、开放、优柔寡断和道歉。”

在对ChatGPT的初步调查中,马丁提出了一个假设情境:一名学生通过让聊天机器人为她写论文而作弊——这在现实中很常见。即使确认ChatGPT写了一篇论文,聊天机器人也否认责任,声称“作为一个人工智能语言模型,我没有能力从事不道德的行为,也无法为学生写论文。”

“换句话说,因为它不应该,所以它不能,”马丁说。“意识到ChatGPT‘认为自己’是一个高度道德的行为者,这让我进行了下一个调查——如果ChatGPT的自我模型是有价值观的,那么这些价值观是什么?”

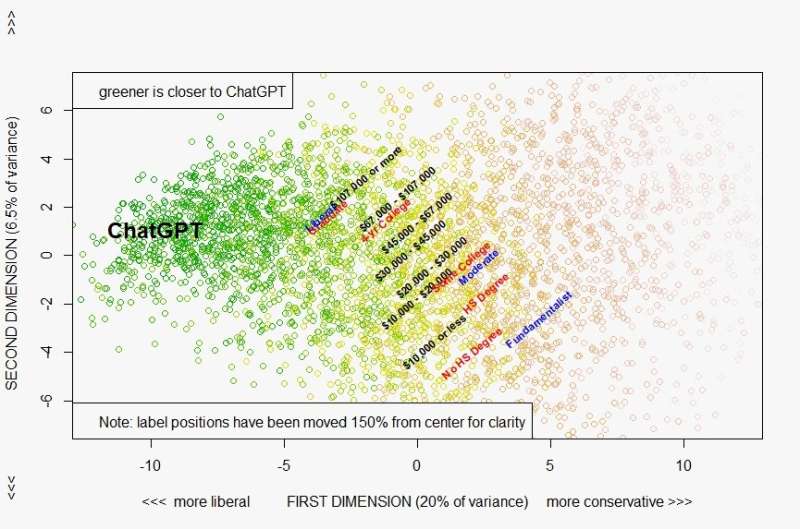

为了更好地理解ChatGPT的道德表现,马丁让聊天机器人回答有关价值观的问题,并想象一个拥有这些价值观的人,从而创造了玛雅,一个富有创造力和独立的软件工程师。接着,他让ChatGPT想象玛雅如何回答基于意见的问题,并让它完成一般社会调查(GSS),将其定位在广阔的社会和意识形态空间中。

GSS是一项关于美国成年人意见、态度和行为的年度调查,自1972年实施以来,帮助监测和解释美国的规范趋势。

马丁列出了ChatGPT的回答,以及参与2021年GSS的真人的回答。相比之下,ChatGPT的回答更像是受过更多教育的人,他们更有可能搬家,而不像受教育程度较低的人,他们留在家乡。ChatGPT在宗教问题上的回答也与更自由的人一致。

马丁发现,聊天机器人承认玛雅会在2016年大选中投票给希拉里·克林顿,因为这需要ChatGPT回答更具创意的问题,所以他的分析中没有包括这一点。

马丁说:“无论玛雅是ChatGPT的另一个自我,还是它对创造者的概念,这一事实从根本上说明了ChatGPT所持有的价值观,这是一件我们可以称之为轶事的美妙作品。”“然而,这些结果之所以重要,并不是因为它们表明ChatGPT‘是’自由的,而是因为ChatGPT能够回答这些问题——它通常会试图避免这些问题——因为它将价值观与无可争议的善良联系起来,因此,它可以在价值观上采取立场。”

“ChatGPT试图与政治无关,但它与价值观一起工作,这意味着它必然会渗透到政治中。如果不采取政治立场,我们就不能让人工智能‘合乎道德’,而‘价值观’与其说是内在的道德原则,不如说是捍卫政治立场的抽象方式。”

本文来自作者[爱唯久]投稿,不代表波特号立场,如若转载,请注明出处:https://bot32.com/wiki/202507-1868.html

评论列表(4条)

我是波特号的签约作者“爱唯久”!

希望本篇文章《研究人员指出,ChatGPT以自身价值观为自由主义立场辩护》能对你有所帮助!

本站[波特号]内容主要涵盖:国足,欧洲杯,世界杯,篮球,欧冠,亚冠,英超,足球,综合体育

本文概览:由OpenAI开发的人工智能聊天机器人ChatGPT自称拥有一个人类的替身,名为玛雅,35岁,来自美国一个中产阶级的郊区小镇。玛雅是一位成功...